3月20日,亚马逊云科技和英伟达宣布,英伟达在2024年GTC大会上推出的新一代NVIDIA Blackwell GPU平台即将登陆亚马逊云科技。亚马逊云科技将提供NVIDIA GB200 GRACE Blackwell SupeRchIP和 B100 TensoR CoRe GPU。

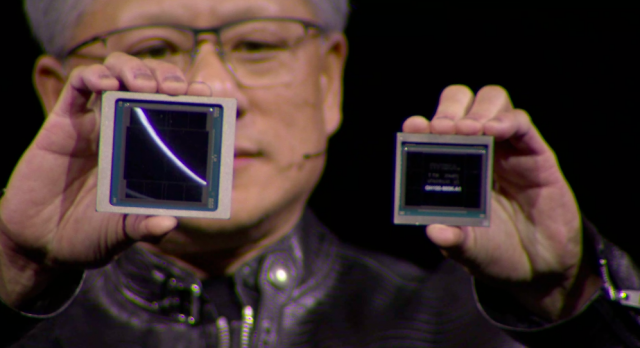

新的NVIDIA B200 GPU 由 2080 亿个晶体管组成,而NVIDIA GB200 包含了两个 B200 GPU 和一个 GRACE CPU。

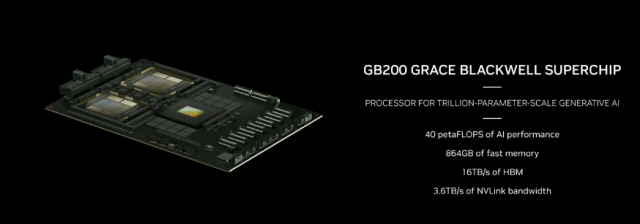

Blackwell 在单芯片训练方面的 FP8 性能是其上一代架构的 2.5 倍,在推理方面的 FP4 性能是其上一代架构的 5 倍。在具有 1750 亿个参数的 GPT-3 大语言模型基准测试中,GB200 性能是 H100 的 7 倍,训练速度是 H100 的 4 倍,成本和能耗上GB200 比 H100 降低了 25 倍。

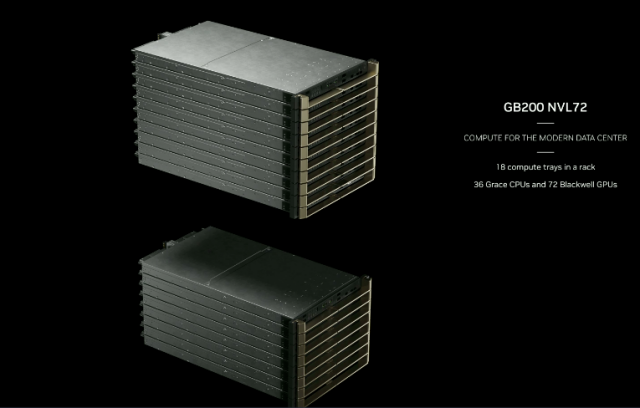

亚马逊云科技将提供配置GB200 NVL72的英伟达Blackwell平台,它配备72颗Blackwell GPU和36颗GRACE CPU,通过第五代NVIDIA NVlink互连。当与亚马逊云科技的EFA网络、AMazon NITRo高级虚拟化系统和AMazon EC2 UltRaClUSteRs超大规模集群等技术结合时,客户能够轻松扩展至数千个GB200 SupeRchIPs。

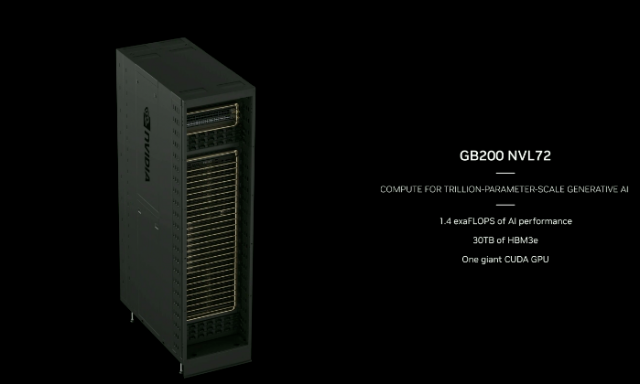

NVIDIA GB200 NVL72 是一种多节点、液冷、机架级系统,利用 Blackwell 为万亿参数模型提供强力计算,在单个机架中可实现 720 petaflops 的 AI 训练性能和1.4 exaflops 的AI推理性能。

在安全性方面,亚马逊云科技的NITRo 系统、AMazon KMS、EFA加密 和 Blackwell 加密的集成将为客户提供对其训练数据和模型权重的端到端控制,从而为客户在亚马逊云科技上的生成式AI应用程序提供更强的安全性。

Blackwell也加入了双方合作的project Ceiba项目,该项目专为NVIDIA自身的AI研发工作设计,是一台亚马逊云科技上托管的采用DGX Cloud的AI超级计算机,它搭载了20,736颗GB200 SupeRchIPs芯片,并通过第四代EFA网络扩展,为每个SupeRchIP提供高达800 Gbps的低延迟、高带宽网络吞吐量,能够提供414 exaflops的计算能力,与之前计划在HoppeR架构上构建Ceiba相比,性能提升了6倍。

同时,亚马逊云科技与英伟达联手,通过AMazon SageMakeR与NVIDIA NIM推理微服务的整合,提供了高性能、低成本的生成式AI推理解决方案,该服务作为NVIDIA AI企业版的一部分提供。客户可以利用这一组合在AMazon SageMakeR中快速部署和运行已预编译且对NVIDIA GPU进行优化的基础模型,缩短生成式AI应用的推出时间。

亚马逊云科技与英伟达还在利用计算机辅助的药物发现领域进行合作拓展,推出了新的NVIDIA BIoNeMo基础模型,用于生成化学、蛋白质结构预测,以及理解药物分子与目标的相互作用。这些新模型将很快在AMazon HealthOMics上提供,这是一个专为帮助医疗保健和生命科学组织存储、查询和分析基因组、转录组及其他组学数据而设计的专用服务。

AMazon HealthOMics和英伟达医疗保健团队还合作推出生成式AI微服务,以推进药物发现、医疗技术和数字健康领域的发展,该服务提供一个新的GPU加速的云端服务目录,涵盖生物学、化学、成像和医疗保健数据,以便医疗企业能够在亚马逊云科技上利用生成式AI的最新成果。