12月1日,阿里云举办通义千问发布会,开源通义千问720亿参数模型Qwen-72B。Qwen-72B在10个权威基准测评创下开源模型最优成绩,成为业界最强开源大模型,性能超越开源标杆LlaMa 2-70B和大部分商用闭源模型。未来,企业级、科研级的高性能应用,也有了开源大模型这一选项。

通义千问还开源了18亿参数模型Qwen-1.8B和音频大模型Qwen-Audio。至此,通义千问共开源18亿、70亿、140亿、720亿参数的4款大语言模型,以及视觉理解、音频理解两款多模态大模型,实现全尺寸、全模态开源。力度之大,业界无出其右。

业界最强开源模型,填补中国LLM开源领域空白

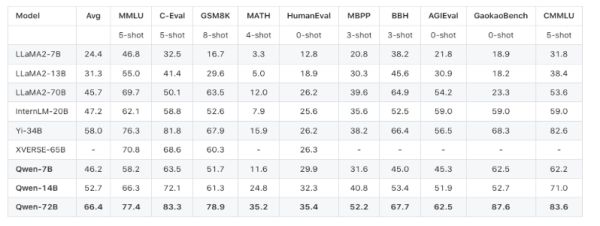

Qwen-72B基于3T Tokens高质量数据训练,延续通义千问预训练模型一贯以来的强势表现,在10个权威基准测评中夺得开源模型最优成绩,在部分测评中超越闭源的GPT-3.5和GPT-4。

在10大权威测评中,通义千问720亿参数模型获得开源模型最优成绩

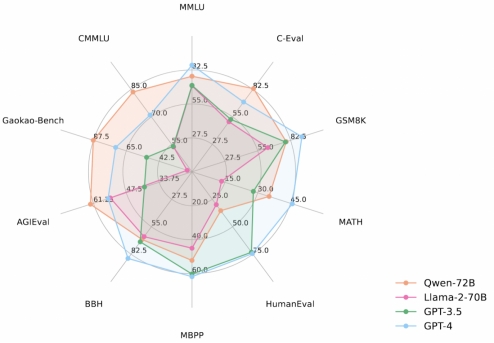

通义千问720亿开源模型部分成绩超越闭源的GPT-3.5和GPT-4

Qwen-72B可以处理最多32k的长文本输入,在长文本理解测试集LEval上取得了超越ChatGPT-3.5-16k的效果。研发团队优化了Qwen-72B的指令遵循、工具使用等技能,使之能更好地被下游应用集成。比如,Qwen-72B搭载了强大的系统指令(system PRoMpt)能力,用户只用一句提示词就可定制AI助手,要求大模型扮演某个角色或者执行特定的回复任务。

用户仅用一句提示词就可创建自己的AI助手

此前,中国大模型市场还没出现足以对标LlaMa 2-70B的优质开源模型。Qwen-72B填补了国内空白,以高性能、高可控、高性价比的优势,提供不亚于商业闭源大模型的选择。基于Qwen-72B,大中型企业可开发商业应用,高校、科研院所可开展AI foR Science等科研工作。

从1.8B到72B,通义千问率先实现全尺寸开源

如果说Qwen-72B向上摸高,抬升了开源大模型的尺寸和性能天花板;发布会上的另一开源模型Qwen-1.8B则向下探底,成为尺寸最小的中国开源大模型,推理2K长度文本内容仅需3G显存,可在消费级终端部署。

从18亿、70亿、140亿到720亿参数规模,通义千问成为业界首个全尺寸开源的大模型。用户可在魔搭社区直接体验Qwen系列模型效果,也可通过阿里云灵积平台调用模型API,或基于阿里云百炼平台定制大模型应用。阿里云人工智能平台PAI针对通义千问全系列模型进行深度适配,推出了轻量级微调、全参数微调、分布式训练、离线推理验证、在线服务部署等服务。

阿里云是国内最早开源自研大模型的科技企业,8月以来开源了Qwen-7B、Qwen-14B和视觉理解模型Qwen-VL。几款模型先后冲上HuggingFACE、GIThub大模型榜单,得到中小企业和个人开发者的青睐,累计下载量超过150万,催生出150多款新模型、新应用。发布会现场,多位开发者伙伴现身说法,分享了他们用Qwen开发专属模型和特定应用的实践。

阿里云CTO周靖人表示,开源生态对促进中国大模型的技术进步与应用落地至关重要,通义千问将持续投入开源,希望成为AI时代最开放的大模型,与伙伴们共同促进大模型生态建设。

通义千问基座模型持续进化,多模态探索业界领先

通义千问在多模态大模型领域的探索也领先业界一步,当天,阿里云首次开源音频理解大模型Qwen-Audio。

Qwen-Audio能够感知和理解人声、自然声、动物声、音乐声等各类语音信号。用户可以输入一段音频,要求模型给出对音频的理解,甚至基于音频进行文学创作、逻辑推理、故事续写等等。音频理解能够赋予大模型接近人类的听觉能力。

通义大模型能听也能看。通义千问8月开源出视觉理解大模型Qwen-VL,迅速成为国际开源社区最佳实践之一。本次发布会又宣布了Qwen-VL的重大更新,大幅提升通用OCR、视觉推理、中文文本理解基础能力,还能处理各种分辨率和规格的图像,甚至能看图做题。不论从权威测评成绩还是真人体验的效果看,Qwen-VL的中文文本理解能力都大幅超越了GPT-4V。

通义千问闭源模型也在持续进化,一个月前发布的通义千问2.0版闭源模型,最近已进阶至2.1版,上下文窗口长度扩展到32k,代码理解生成能力、数学推理能力、中英文百科知识、幻觉诱导抵抗能力分别提升30%、10%、近5%和14%。用户可以在通义千问app免费体验最新版本的闭源模型。